一、该问题的重现步骤是什么?

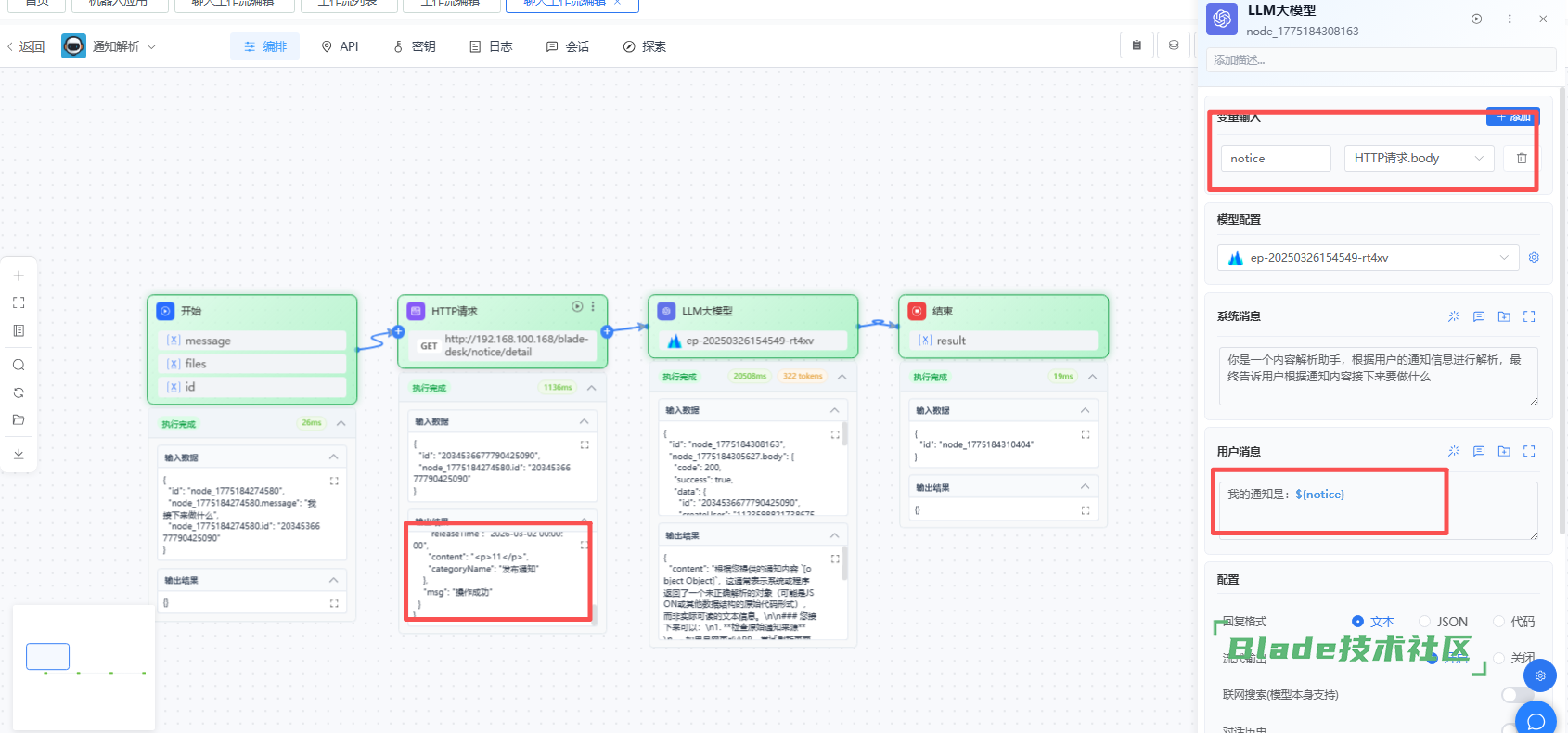

1. 新建对话流程编排,增加HTTP请求节点->LLM大模型节点接收API返回数据

2. 如下:

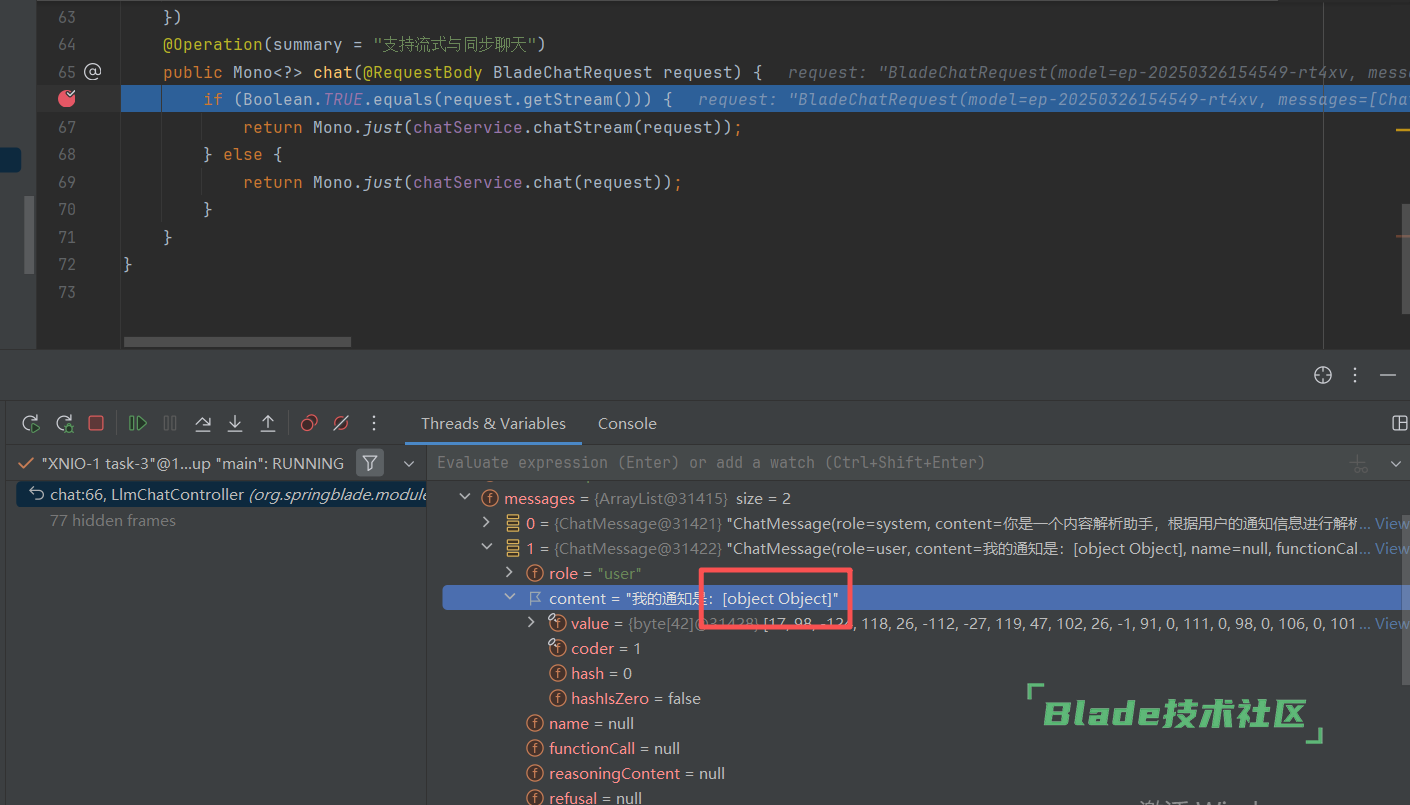

3.后端接收到的notice为Object

二、你期待的结果是什么?实际看到的又是什么?

后端接收到的用户消息:${notice} 应该为通过接口返回的内容,应该如何实现直接接收到信息内容或整个返回数据信息

三、你正在使用的是什么产品,什么版本?在什么操作系统上?

BladexAI

四、请提供详细的错误堆栈信息,这很重要。

五、若有更多详细信息,请在下面提供。

扫一扫访问 Blade技术社区 移动端